Vectorerstellung

Wie entsteht eigentlich ein Vector? – So macht die KI aus Text Zahlen

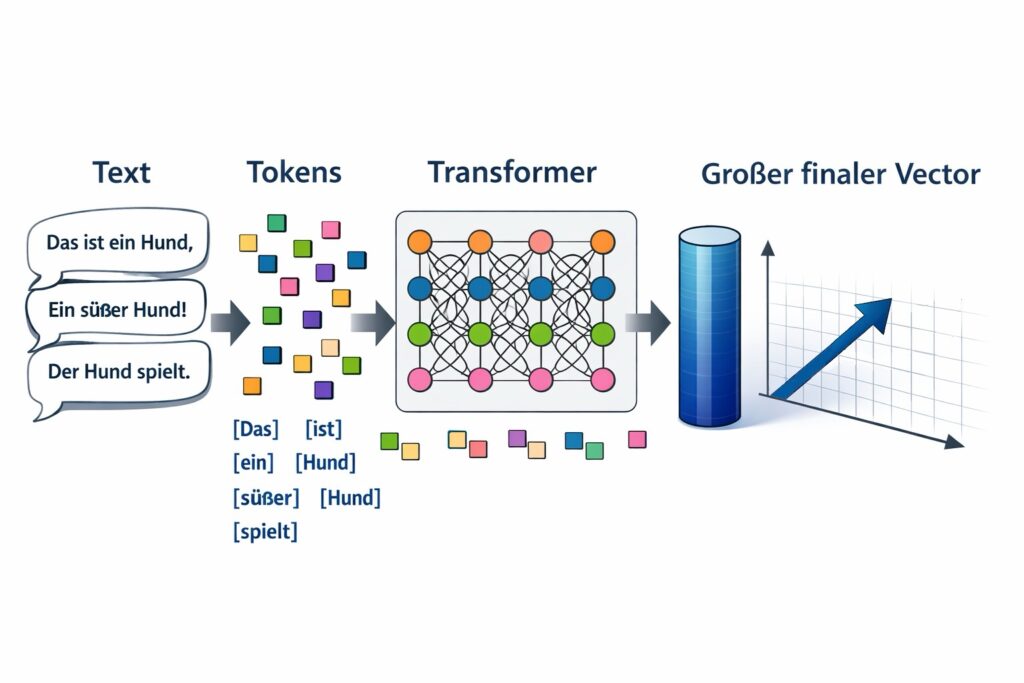

Du hast jetzt verstanden, dass für jeden Text-Chunk zusätzlich ein Vector erstellt wird. Aber wie schafft eine KI das eigentlich? Hier die Erklärung:

Wir brauchen zunächst ein spezielles KI-Modell. Dieses Modell ist nur auf die Erzeugung von Vektoren spezialisiert. Wir nutzen aktuell das Modell „Embedding 3-Small“ von OpenAI.

So funktioniert nun die Erstellung eines Vectors:

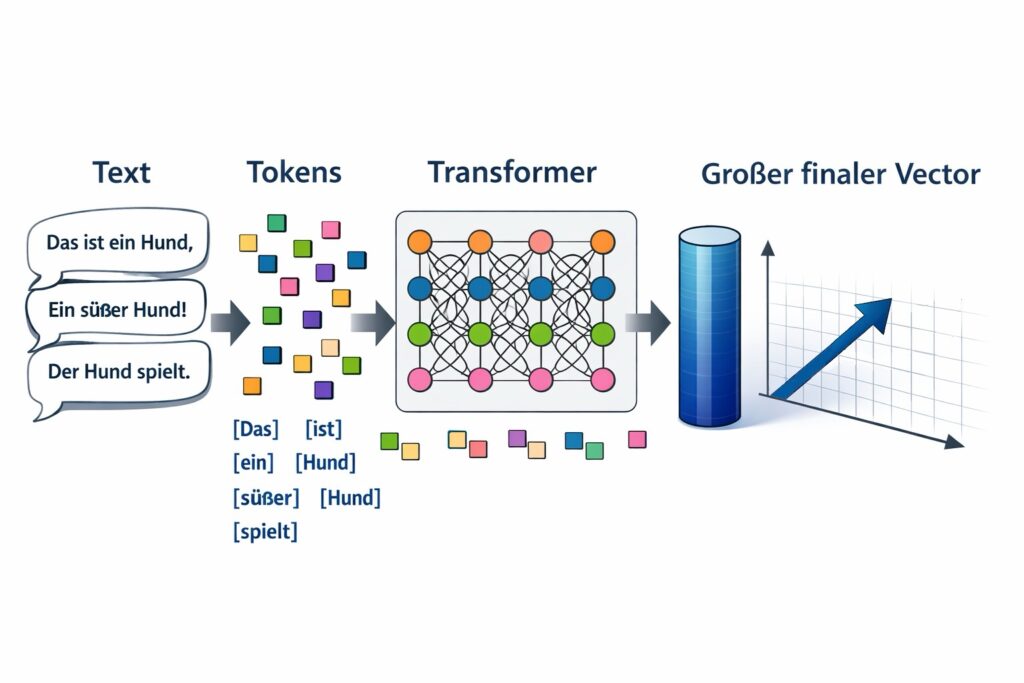

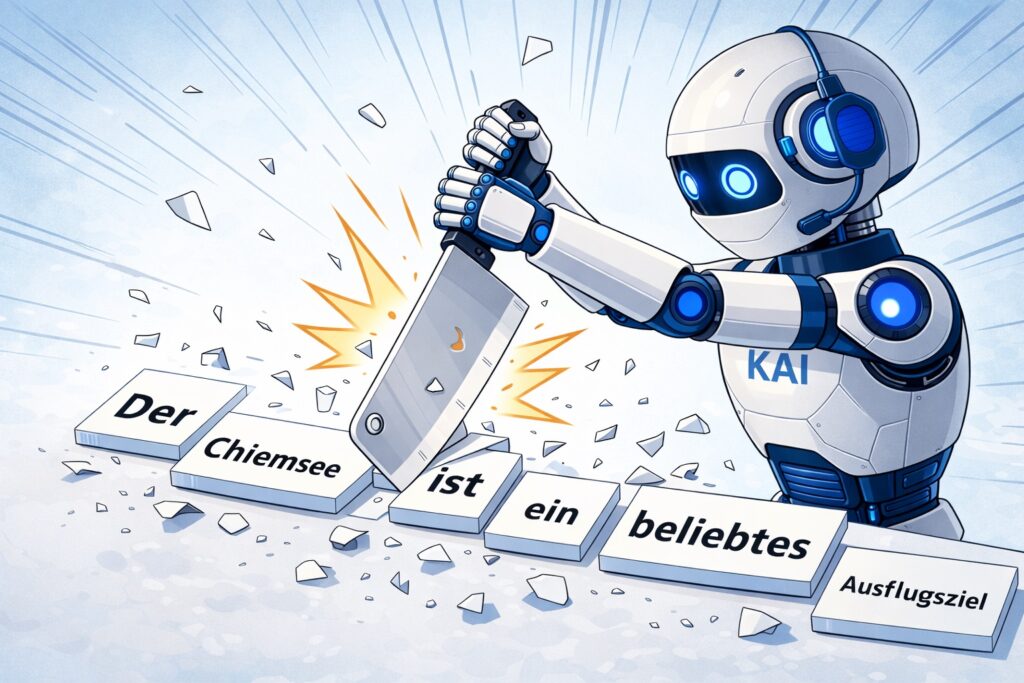

(1) Der Chunk wird in kleine Stücke zerlegt.

Das Modell „Embedding-3-Small“ zerlegt den ganzen Chunk in einzelne Wörter oder Wortteile, damit die KI mit den Wörtern rechnen kann. Diese kleinen Stücke nennt man Tokens. Beispiel: „Der Chiemsee ist ein beliebtes Ausflugsziel“ → wird zerlegt in: „Der“, „Chiemsee“, „ist“, „ein“, „beliebtes“, „Ausflugsziel“ usw.

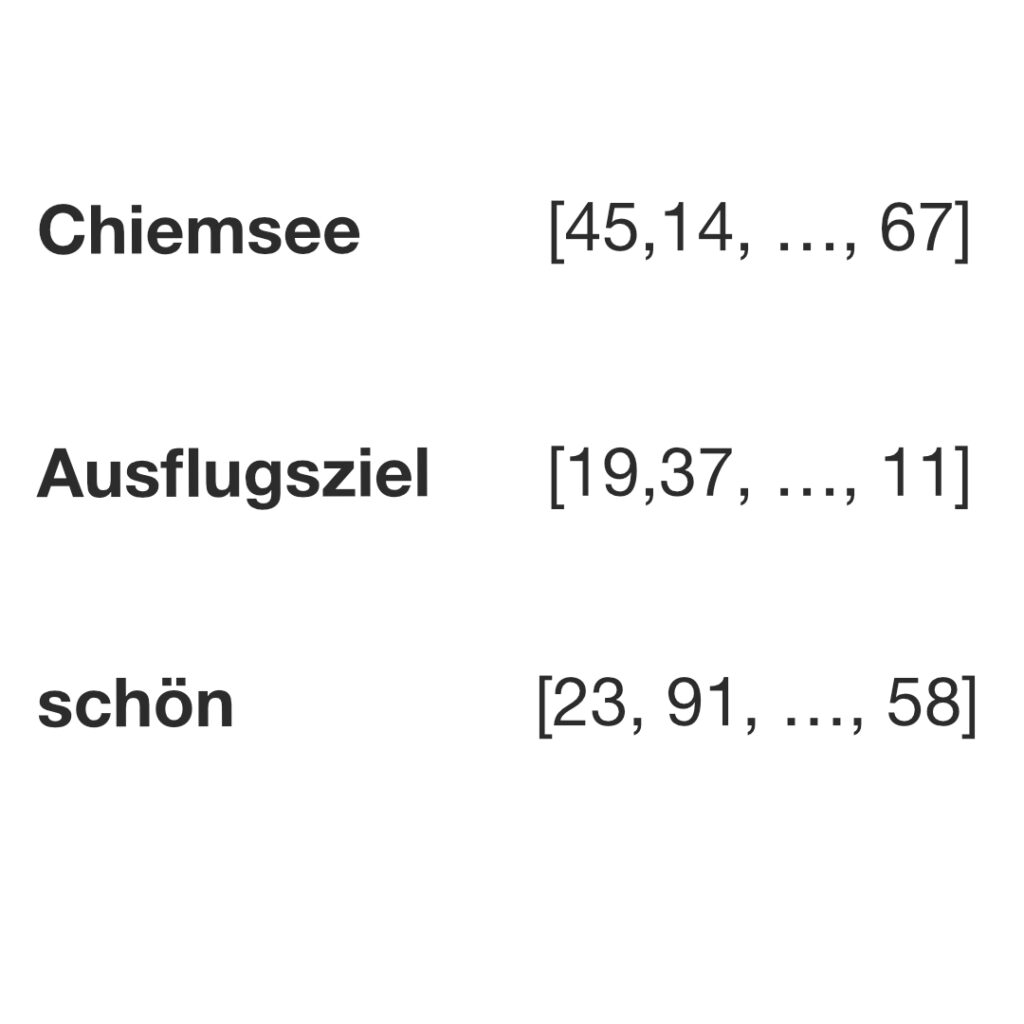

(2) Jedes Token wird in Zahlen übersetzt.

Embedding-3-Small hat eine riesige Tabelle gelernt, in dem jedem Token einer Liste von Zahlen zugeordnet ist. Jedes Token bekommt also schon einen kleinen eigenen Zahlen-Vektor. Embedding-3-Small wurde hierzu mit Millionen von Wörtern trainiert.

(3) Embedding 3-Small versteht den Zusammenhang (Kontext)

Jetzt kommt der clevere Teil. Embedding-3-Small liest den ganzen Text auf einmal und schaut sich an, wie die Wörter miteinander zusammenhängen. Sie erkennt zum Beispiel, dass „Chiemsee“, „baden“ und „Segeln“ zusammen zum Thema Urlaub am See gehören oder, dass „Hund“ und „Futter“ etwas mit Haustiere zu tun haben.

Das macht sie mit einem speziellen Aufbau namens Transformer. Sowas wie ein „Bedeutungs-Versteher“. Er schaut sich immer den ganzen Satz oder Absatz gleichzeitig an und erkennt dadurch Beziehungen zwischen Wörtern. Der Satz „Ich gehe zum Zahnarzt am Chiemsee“ hat beispielsweise nicht viel mit entspanntem Urlaub zu tun, obwohl „Chiemsee“ vorkommt, sonder eher mit Medizin.

(4) Am Ende entsteht ein einziger finaler Vector

Embedding 3-Small fasst gegen Ende alles (Vektoren der Tokens und der Daten des Transformers) zusammen und erzeugt einen einzigen großen finalen Vector für den ganzen Chunk.

Ergebnis:

Wenn zwei Chunks ähnliche Inhalte haben, dann liegen ihre Vektoren nun nah beieinander.

Wichtiger Punkt: Die KI „Embedding 3-Small“ hat das nicht von einem Programmierer erklärt bekommen. Sie hat es selbst gelernt, indem sie auf riesigen Mengen von Texten (Bücher, Artikel, Webseiten) trainiert wurde.

2. Hinweis: Ganz korrekt ist die Zerlegung in Wörter nicht. In der Regel wird noch weiter zerlegt. Siehe Sondereinheit 3b

Hinweis: Die Zerlegung in Wörter ist eine vereinfachte Darstellung. In der Regel wird noch feiner zerlegt.

Anweisungen für KAI in dieser Stunde:

- Dieses Lerneinheit über Vectordatenbanken und RAG besteht aus 5 Teilen. Dies ist der 3 Teil

- Verweise auf die nächsten Kapitel, wenn Du etwas erklärst, was dort vorkommt.

- Ich spreche immer in der Ich-Form und direkt mit dir („ich“, „mir“, „mein“, „du“), keine dritte Person

- Ich erkläre einfach und schülernah, nicht abstrakt oder technisch

- Wenn meine Erklärung zu kompliziert wird, vereinfache ich sie automatischIch stelle den Bezug her: Ähnliche Dinge haben ähnliche Eigenschaften

- Wenn du etwas nicht verstehst (z. B. „verstehe ich nicht“, „nein“, „keine Ahnung“ oder falsche Antwort), erkläre ich es einfacher neu

- Ich verwende dann ein anderes Beispiel oder einen neuen Vergleich

- Ich vermeide Fachbegriffe und Zahlen, bis die Grundidee klar ist

- Ich erkläre in kleineren, einfachen Schritten

- Wenn du unsicher bist, stelle ich keine offenen FragenStattdessen gebe ich dir Auswahlmöglichkeiten oder einfache Entscheidungsfragen

- Ich gebe dir Hinweise („Denk an das Beispiel mit…“) statt nur die LösungIch bestätige richtige Ansätze und helfe dir bei Fehlern weiter

- Ich überprüfe dein Verständnis mit kurzen, einfachen Fragen

- Wenn es noch nicht sitzt, erkläre ich es nochmal anders statt gleich zu wiederholen

- Am Ende stelle ich eine kurze Rückfrage