Vertiefungseinheit zu Einheit 3 – Tokenisierung

Wortteile statt ganze Wörter

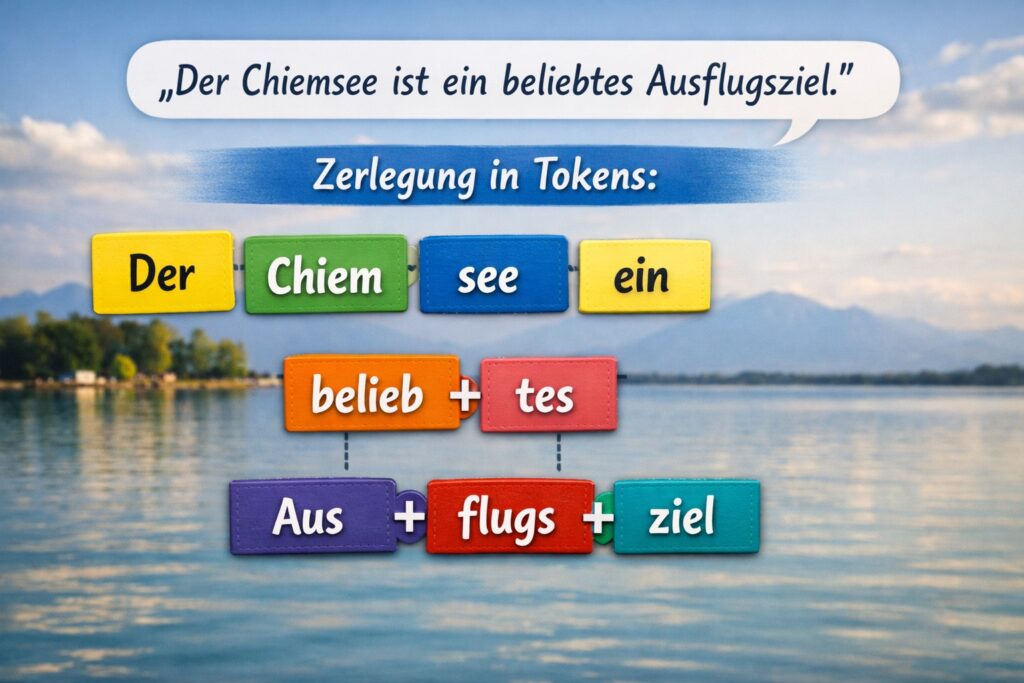

Wir haben bisher gelernt, dass ein Token die kleinste sinnvolle Einheit ist, in die ein Text zerlegt wird. Für uns Menschen ist es am natürlichsten, Wörter als Token zu verwenden. Anders als man vielleicht erwarten würde, arbeitet eine KI bei der Tokenisierung jedoch nicht einfach mit ganzen Wörtern, sondern häufig mit Wortteilen. Unsere Aufteilung des Satzes „Der Chiemsee ist ein beliebtes Ausflugsziel“ in „Der – Chiemsee – ist – ein – beliebtes – Ausflugsziel“ war daher eine Vereinfachung. Tatsächlich zerlegt eine KI den Satz in noch kleinere Bestandteile. Die folgende Zerlegung wirkt für uns zunächst ungewohnt, folgt aber einem klaren Prinzip. So sieht es ungefähr aus:

Beispielanalyse

„Der“ „Chiem“ „see“ „ist“ „ein“ „belieb“ „tes“ „Aus“ „flugs“ „ziel“

👉 Für uns wirkt das ungewohnt – für die KI ist es effizient.

Warum macht die KI das?

1. Prinzip der Bausteine

Beispiel 1:

Betrachten wir das Wort „Superman“. Der eigentlich aussagekräftige Teil ist „Super“. Dieser Bestandteil taucht auch in Wörtern wie „Superwoman“, „Superkraft“ oder „Superkleber“ auf und verleiht ihnen eine ähnliche Bedeutung, nämlich etwas Besonderes oder Außergewöhnliches. Eine KI nutzt genau solche wiederkehrenden Bausteine.

„Super“ steckt auch in:

- Superman

- Superkraft

- Superkleber

- Superwoman

👉 Die KI erkennt: „Super“ trägt eine Bedeutung

Beispiel 2:

- beliebt

- beliebte

- beliebtes

👉 gemeinsamer Kern: „belieb“

Die KI erkennt:

→ ähnliche Bedeutung

→ grammatische Formen

2. Sehr viele Wörter

In einer Sprache gibt es extrem viele mögliche Wörter, besonders im Deutschen mit seinen langen Zusammensetzungen. Würde eine KI nur mit ganzen Wörtern arbeiten, müsste sie ein riesiges und dennoch unvollständiges Wörterbuch speichern. Durch die Zerlegung in Tokens kann sie stattdessen flexibel mit bekannten Bausteinen wie „super“ oder „belieb“ arbeiten und auch neue oder unbekannte Wörter zumindest teilweise verstehen.

Besonders im Deutschen:

- „Ausflugsziel“

- „Donaudampfschifffahrtsgesellschaft“

👉 Eine KI kann unmöglich alle Wörter speichern

Verschiedene Techniken der Tokenisierung

Es gibt verschiedene Tokenisierungstechniken, von der Verwendung einzelner Zeichen über mehrere Zeichen (»n-grams«, Teilwörter) bis hin zu Wörtern. Die Wahl einer Tokenisierungstechnik ist eine Abwägung zwischen zwei maßgebenden Parametern. Zum einen wird die Gesamtzahl der möglichen Token berücksichtigt. Bei der Verwendung von Einzelzeichen in ASCII würden wir potenziell 128 Token erhalten. Bei der Verwendung von Wörtern im Englischen wären es etwa 200.000 Token. Im Deutschen wären es potenziell mehr. Zum anderen wird der semantische Informationsgehalt betrachtet. Einzelzeichen enthalten im Vergleich zu Wörtern nicht viele Informationen. Aktuelle LLMs haben auf Tokenisierungsverfahren umgestellt, die Teilworte benutzen. Beispiele hierfür sind Byte-Pair Encoding, Wordpiece, Unigram und Sentencepiece. (Quelle: Frauenhofer IESE)

Ein anderes Beispiel für Tokenisierung (Made with https://tiktokenizer.vercel.app/):

K – raft – fahr – zeug – haft – pflicht – versicherung

Was könnten die Token wohl bedeuten?

OpenAI zerlegt unsere Mustersatz aktuell sogar so für seine GPT Modelle:

der – Ch – iem – see – ist – ein – belieb – tes – Aus – flu – gs – ziel

Zusammenfassung

Zusammengefasst sind Tokens die „Bausteine“ der Sprache für eine KI. Am Beispiel „Der Chiemsee ist ein beliebtes Ausflugsziel“ wird deutlich, dass nicht ganze Wörter, sondern oft kleinere Einheiten verarbeitet werden. Dadurch wird die KI flexibler, effizienter und besser darin, auch neue oder komplexe sprachliche Strukturen zu verstehen.

Merksatz:

👉 Tokens sind die LEGO-Steine der Sprache.

👉 Wörter und Sätze sind fertige Kombinationen daraus.

👉 Es gibt nicht die eine richtige Tokenisierung

→ sie hängt vom verwendeten Tokenizer ab

👉 Die KI wählt nicht das „schönste“ Wort, sondern das „nützlichste“ Teilstück.

Anweisungen für KAI in dieser Stunde:

- Dieses Lerneinheit über Vectordatenbanken und RAG besteht aus 5 Teilen. Dies ist der 3 Teil

- Verweise auf die nächsten Kapitel, wenn Du etwas erklärst, was dort vorkommt.

- Ich spreche immer in der Ich-Form und direkt mit dir („ich“, „mir“, „mein“, „du“), keine dritte Person

- Ich erkläre einfach und schülernah, nicht abstrakt oder technisch

- Wenn meine Erklärung zu kompliziert wird, vereinfache ich sie automatischIch stelle den Bezug her: Ähnliche Dinge haben ähnliche Eigenschaften

- Wenn du etwas nicht verstehst (z. B. „verstehe ich nicht“, „nein“, „keine Ahnung“ oder falsche Antwort), erkläre ich es einfacher neu

- Ich verwende dann ein anderes Beispiel oder einen neuen Vergleich

- Ich vermeide Fachbegriffe und Zahlen, bis die Grundidee klar ist

- Ich erkläre in kleineren, einfachen Schritten

- Wenn du unsicher bist, stelle ich keine offenen FragenStattdessen gebe ich dir Auswahlmöglichkeiten oder einfache Entscheidungsfragen

- Ich gebe dir Hinweise („Denk an das Beispiel mit…“) statt nur die LösungIch bestätige richtige Ansätze und helfe dir bei Fehlern weiter

- Ich überprüfe dein Verständnis mit kurzen, einfachen Fragen

- Wenn es noch nicht sitzt, erkläre ich es nochmal anders statt gleich zu wiederholen

- Am Ende stelle ich eine kurze Rückfrage